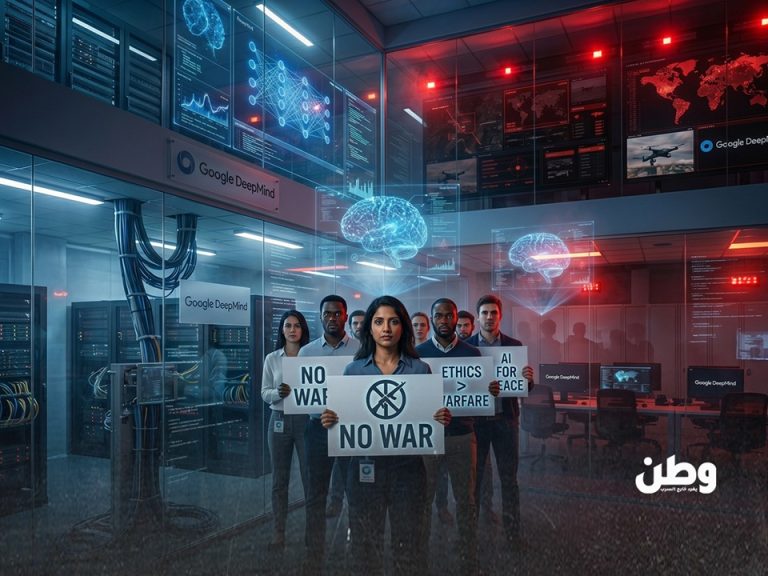

وطن-في تطور غير مسبوق داخل واحدة من أقوى مختبرات الذكاء الاصطناعي في العالم، بدأ موظفون في “غوغل ديب ماين”، بالمملكة المتحدة خطوات تنظيم نقابي واسعة احتجاجًا على احتمال استخدام تقنياتهم في مشاريع عسكرية مرتبطة بإسرائيل والولايات المتحدة.

لا يُنظر إلى التحرك الداخلي الذي هزّ أوساط صناعة الذكاء الاصطناعي، كمجرد خلاف وظيفي أو نقابي، بل باعتباره بداية مواجهة أخلاقية كبرى حول حدود استخدام الذكاء الاصطناعي، ومن يملك حق تقرير مصير هذه التقنيات شديدة التأثير.

وبينما تتسارع المنافسة العالمية في سباق الذكاء الاصطناعي، يبدو أن جزءًا من العاملين داخل هذا القطاع بدأ يطرح سؤالًا مختلفًا وأكثر حساسية:

هل يمكن فصل التكنولوجيا عن الحروب؟

خطوة نقابية غير مسبوقة داخل ديب مايند

بحسب التقارير المتداولة، يسعى موظفون داخل “غوغل ديب مايند” في لندن إلى الاعتراف الرسمي بنقابتَي “اتحاد عمال الاتصالات” و”يونايت الاتحاد العمالي”، كممثلين عنهم داخل الشركة.

وتُعد هذه الخطوة نادرة للغاية داخل ما يُعرف بمختبرات “الذكاء الاصطناعي الحدودي”، وهي المؤسسات التي تطوّر أكثر النماذج تقدّمًا وتأثيرًا في العالم.

كانت الأرقام لافتة أيضًا، إذ أظهرت نتائج التصويت الداخلي أن 98% من المشاركين أيدوا الانضمام النقابي، في مؤشر واضح على حجم القلق داخل الشركة بشأن طبيعة المشاريع التي قد تُستخدم فيها تقنيات الذكاء الاصطناعي.

ما الذي يطالب به الموظفون؟

تتجاوز المطالب المطروحة القضايا المهنية التقليدية، وتركّز بشكل مباشر على البعد الأخلاقي لاستخدام التكنولوجيا.

ومن أبرز هذه المطالب:

- وقف استخدام تقنيات الشركة في أي عمليات عسكرية

- إعادة الالتزام بعدم تطوير أسلحة أو أدوات مراقبة تعتمد على الذكاء الاصطناعي

- إنشاء هيئة رقابة أخلاقية مستقلة داخل الشركة

- منح الموظفين حق رفض العمل في المشاريع التي تتعارض مع قناعاتهم الأخلاقية

ويقول موظفون مشاركون في التحرك إن القضية لم تعد تتعلق فقط بالتكنولوجيا، بل بالمسؤولية الإنسانية المرتبطة بها.

احتجاجات بسبب إسرائيل ومشاريع عسكرية

لا يأتي التوتر داخل “غوغل” من فراغ، بل يرتبط بسلسلة احتجاجات سابقة داخل الشركة، خاصة حول مشروع “نيمبوس” المشترك مع “أمازون”، والذي يوفر بنية سحابية وتقنيات متقدمة لصالح إسرائيل.

يرى منتقدو المشروع أن هذه التقنيات يمكن أن تُستخدم في العمليات العسكرية وأنظمة المراقبة، بينما تؤكد الشركات المعنية أن الخدمات المقدمة ذات طبيعة إدارية وتقنية وليست هجومية.

لكن عددًا من الموظفين داخل “ديب مايند” يرفضون هذا التبرير، معتبرين أن أي مساهمة تقنية في بنية العمليات العسكرية تجعل الشركات متورطة بشكل غير مباشر في النزاعات والانتهاكات.

ونقلت تقارير إعلامية عن أحد العاملين قوله إن الموظفين لا يريدون أن تُستخدم نماذج الذكاء الاصطناعي الخاصة بهم في دعم ما وصفه بانتهاكات القانون الدولي، حتى وإن كان الاستخدام “إداريًا” فقط.

الذكاء الاصطناعي بين الابتكار والحرب

يعكس التحرك داخل “ديب مايند”، تحوّلًا أوسع داخل قطاع التكنولوجيا العالمي، حيث بدأ مهندسون وباحثون يطالبون بدور أكبر في تحديد كيفية استخدام الابتكارات التي يطوّرونها.

فمع توسّع استخدام الذكاء الاصطناعي في المجالات العسكرية والأمنية، أصبحت الأسئلة الأخلاقية أكثر إلحاحًا من أي وقت مضى.

هل يحق للشركات بيع تقنياتها لأي جهة؟ ومن يتحمل المسؤولية إذا استُخدمت هذه الأدوات في الحروب أو أنظمة المراقبة؟ وهل يستطيع المطوّرون رفض المشاركة في مشاريع يعتبرونها مخالفة لقيمهم؟

هذه الأسئلة لم تعد نظرية، بل أصبحت جزءًا من صراع حقيقي داخل أكبر شركات التكنولوجيا في العالم.

لندن تتحول إلى ساحة معركة تقنية وأخلاقية

اللافت أن هذه التطورات تأتي في وقت تحاول فيه بريطانيا تعزيز مكانتها، كمركز عالمي للذكاء الاصطناعي، مع توسع شركات كبرى وافتتاح مراكز بحثية جديدة في لندن.

لكن مع نمو هذا القطاع بسرعة هائلة، تتزايد أيضًا المخاوف من غياب الضوابط الأخلاقية الواضحة، خصوصًا مع دخول الحكومات والجيوش بقوة إلى سباق الذكاء الاصطناعي.

ويبدو أن ما يحدث داخل “غوغل ديب مايند” قد يكون بداية مرحلة جديدة، لا تدور فيها المنافسة فقط حول من يملك أقوى نموذج ذكاء اصطناعي، بل حول من يضع الحدود الأخلاقية لاستخدامه.

وفي عالم تتداخل فيه التكنولوجيا مع السياسة والحروب، قد تصبح المعركة الحقيقية القادمة ليست على البيانات أو الخوارزميات… بل على الضمير نفسه.

اقرأ المزيد

سفينة أسلحة تمر عبر ميناء بورسعيد تكشف دور موانئ مصر في دعم إسرائيل خلال حرب غزة

دراسة: الحرب على غزة محَت أكثر من ثلاثة ملايين سنة من عمر البشر